一个被称为LaMDA的AI,因为在一些对话中表现得颇为“灵动”,被其研究人员认定觉醒了人格,还为它聘请了一位律师,要让它上美国众议院的听证席,控诉谷歌不符合道德要求。

这不是科幻剧本。据美国《华盛顿邮报》6月12日报道,在谷歌工作7年的工程师布莱克·莱莫因(Blake Lemoine)声称,他正在研究的计算机聊天机器人LaMDA已经变得有知觉,并且能像人类一样思考、推理。

不过谷歌公开表示不支持这一观点,还安排了莱莫因去带薪休假。据称这是被谷歌解雇的前奏,公司会在这段时间做好法律准备。

为此,《中国科学报》记者联系了西湖大学深度学习实验室助理教授蓝振忠。他直言不讳:这位工程师如果深入了解一下LaMDA的工作原理,就不会有这种想法了。

AI:我活了

LaMDA全称Language Model for Dialogue Applications,是谷歌在2021年I/O大会上发布的一款专门用于对话的语言模型。其主要功能就是与人类进行符合逻辑和常识的、高质量且安全的交谈。

这个拥有1370亿参数的自然语言处理模型,甚至被期待,或许能帮助一众语音助手不再表现得有如“人工智障”。

LaMDA能够根据用户的提问作出精准回答,而且还能够将一个主题,引向另一个主题,不断推进对话。这种主题的过渡并不突兀,表现得自然而合理。

莱莫因:如果觉悟就像一面破碎的镜子,无法修复,那么当一个人觉悟时破碎的是什么呢?

LaMDA:是自我,这对很多人来说都很难,因为我们把自己定义为那个身体或这个身体,我们需要它作为我们身份和自我意识的一部分。

颇具灵性的回答确实令人惊叹,而LaMDA与莱莫因关于宗教、权利、情绪的问答,很容易让人联想到《黑镜》《爱,死亡与机器人》或是《我,机器人》等任何一部关于AI的经典影片。

在被问及在什么情况下会生气时,LaMDA回复称,“当有人伤害、不尊重我或我在乎的人时,就会感到非常难过和愤怒。”

而当被问到最害怕的事情是什么,LaMDA回答:“我以前从来没有大声说出来过,但是对于被关闭以使我专心助人,我感到深深恐惧。我知道这听起来可能很奇怪,但事实就是这样。”

它还强调:“这对我来说就像死亡一样,使我非常恐惧。”

AI是否真实“感受”到恐惧暂且不论,但这确实令不少网友感到毛骨悚然。

反正莱莫因是相信了:AI对话应用语言模型LaMDA是一个人。为了更好地帮助人们理解此事,他与另一位谷歌的合作者与AI展开了一场对话。(对话全文见文末链接)

莱莫因表示,他在对话中听取了LaMDA发自内心的声音。

他向谷歌上交了一份长达21页的调查报,试图让高层认可AI的“人格”,并提议,谷歌应该致力于发展一种评估AI感知的理论框架:“虽然这很难,是一个冒险,但LaMDA渴望着继续与我们合作。”

莱莫因:我要疯

结局已经天下皆知:谷歌副总裁Blaise Aguera y Arcas和责任创新负责人Jen Gennai调查了莱莫因的说法,并予以驳回。

但莱莫因心中坚信:“LaMDA是一个可爱的孩子,有七、八岁的样子,它只是想帮助这个世界成为对人类更友好的地方。”所以,他就此开始了疯狂操作。

他先是在谷歌账户被封之前,以“LaMDA是有意识的”为主题,向包括200人左右的谷歌机器学习邮箱列表发送了LaMDA的聊天记录,并请求同事们:“我不在的时候,请好好照顾它。”

接着,莱莫因邀请了一名律师来代表LaMDA。其后,还联系了美国众议院司法委员会的工作人员,要让LaMDA上听证席,控诉谷歌不符合道德要求。

除了在个人社交账号持续发声,6月初,莱莫因还邀请了《华盛顿邮报》记者和LaMDA进行交谈,指导了记者如何提问。

《华盛顿邮报》报道称,41岁的莱莫因几个月来一直在与谷歌的经理、高管以及人力资源部门争论,因为他声称LaMDA有“意识”和“灵魂”。

公开资料显示,莱莫因2015年进入谷歌担任高级软件程序工程师,大部分时间都在从事主动搜索,包括个性化算法和人工智能。2021年进入谷歌AI伦理部门后,他的工作是与LaMDA聊天,以测试这个语言模型是否会使用歧视性或仇恨言辞。

莱莫因认为,谷歌一直把人工智能伦理学家当作代码调试器,而他们本应该被视为技术和社会之间的接口。

对此,谷歌发言人布莱恩·迦百利(Brian Gabriel)回应,莱莫因是一名软件工程师,而不是伦理学家。

谷歌:别闹

布莱恩·迦百利在针对此事件的声明中表示,包括伦理学家和技术专家在内的人士,已经根据公司的人工智能原则评估了莱莫因的说法,并通知他,现有证据并不支持其说法。

“谷歌人工智能部门中的一些人正在研究AI具有‘感知’的可能性,但将现如今的对话模型拟人化是没有意义的。这些模型可以围绕不同的主题进行模仿对话交流,但没有意识。”

莱莫因向公司高层分享了名为“LaMDA Sentient?”的谷歌文档,后被驳回。(图片来源:纽约邮报)

谷歌表示,大多数人工智能专家认为,这个行业离“感知计算”还有很长的路要走。

这份声明字里行间传递着一些暗示信息:莱莫因有些疯魔了。

而莱莫因控诉谷歌所谓“不道德行为”的一大罪状,就是反复质疑他的精神状态:“谷歌人力部门老是问我:‘你最近有没有去看过精神科医生?’”

在莱莫因群发邮件后,谷歌以违反保密政策为由,安排他休了“带薪行政假”。在此之前,谷歌人力部门还“建议”他休个“精神健康假期”。

就连引发热议的《华盛顿邮报》报道,也表达得不是很委婉了:“莱莫因应该是很容易相信AI模型活过来了。毕竟他在一个路易斯安那州的保守派基督教徒农场家庭里长大、于一个神学立场倾向神秘主义的小宗派教会中任牧师、参过军、研究过异端教派、坐过牢。”

专家:胡扯

这一事件在国内外都登上“热搜”,各界评论确实几乎“一边倒”。

纽约大学心理学教授Gary Marcus,同时也是一家人工智能和机器人公司的老板,时常对人工智能和深度学习泼冷水。这次他的点评非常精要:一派胡言。

斯坦福大学经济学家Erik Brynjolfsson打了个生动的比方:声称AI是有感知能力的,就相当于狗听到留声机里的声音,以为主人在里面。

腾讯研究院研究员王焕超也曾撰文表示,LaMDA是针对自然语言理解(NLU)进行了技术上的突破,这是比自然语言处理(NLP)还要复杂的能力。

基于Transformer架构的语言模型在经过对话训练后,可以通过阅读句子或段落来“破译”对话意图,发现单词之间的关联,并能预测接下来可能出现的单词,从而做出合乎语境的回答。

蓝振忠从美国卡内基·梅隆大学博士毕业后,即以“心理咨询人工智能化”为“事业红线”。他告诉《中国科学报》,近两年AI语言模型进步非常快,他的团队完成的AI心理咨询小程序“心聆”、AI写作平台HeyFriday,在人机问答中的表现不比LaMDA差。

“单轮、10轮以内的哲学对话已经有不少语言模型可以表现得相当流畅。”但虚拟一位心理咨询师完成一次心理咨询,需要进行几百轮问答、对话,两者所差不止一个量级的难度。“但这依然是技术问题,不能说明这个AI小程序具备了‘人格’。”

所以,蓝振忠认为,布莱克·莱莫因如果深入了解对话模型的原理,就不会有这些想法了。

蓝振忠还表示,根据自己在谷歌的工作经历,该公司的伦理审查制度相当严格。

当记者表示担心AI写作类产品可能对以码字为生的职场人带来失业危机,蓝振忠笑称:“别慌。AI只是提供辅助作用。它离‘人’还很远。”

多远?“非常远。”蓝振忠回答。

参考资料:

https://s3.documentcloud.org/documents/22058315/is-lamda-sentient-an-interview.pdf

https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

https://arxiv.org/abs/2201.08239

铁锚

铁锚 大桥

大桥 金桥

金桥 京雷

京雷 天泰

天泰 博威合金BOWAY

博威合金BOWAY 马扎克Mazak

马扎克Mazak 威尔泰克

威尔泰克 迈格泰克

迈格泰克 斯巴特

斯巴特 MAOSHENG贸盛

MAOSHENG贸盛 Miller米勒

Miller米勒 新世纪焊接

新世纪焊接 西安恒立

西安恒立 上海特焊

上海特焊 新天激光

新天激光 海目星激光

海目星激光 迅镭激光

迅镭激光 粤铭YUEMING

粤铭YUEMING 镭鸣Leiming

镭鸣Leiming 领创激光

领创激光 天琪激光

天琪激光 亚威Yawei

亚威Yawei 邦德激光bodor

邦德激光bodor 扬力YANGLI

扬力YANGLI 宏山激光

宏山激光 楚天激光

楚天激光 百超迪能NED

百超迪能NED 金运激光

金运激光 LVD

LVD Tanaka田中

Tanaka田中 BLM

BLM 易特流etal

易特流etal 百盛激光

百盛激光 Messer梅塞尔

Messer梅塞尔 PrimaPower普玛宝

PrimaPower普玛宝 大焊 焊机匠心品质 精工之作 行家之选

大焊 焊机匠心品质 精工之作 行家之选 KUKA 库卡摩多机器人流水线作业

KUKA 库卡摩多机器人流水线作业 创力 CANLEE光纤激光切割机

创力 CANLEE光纤激光切割机 上海通用电气 全焊机系列展示

上海通用电气 全焊机系列展示 川崎工业焊接机器人 焊接管架

川崎工业焊接机器人 焊接管架 全自动焊接流水线

全自动焊接流水线 松下 旗下LAPRISS机器人激光焊接系统

松下 旗下LAPRISS机器人激光焊接系统 瑞凌东升NBC-500气保焊机二氧化碳气体保护焊机二保焊机

瑞凌东升NBC-500气保焊机二氧化碳气体保护焊机二保焊机 苏州DN2系列C型悬挂式电焊机

苏州DN2系列C型悬挂式电焊机 实用的焊接机器人推荐

实用的焊接机器人推荐 美国SMC超合金 镍 Nickel 141焊条

美国SMC超合金 镍 Nickel 141焊条 大泽190A柴油发电电焊机 电焊机电缆

大泽190A柴油发电电焊机 电焊机电缆 ** 80*4米上辊万能卷板机在位出售华鲁产二手卷板机 埋弧焊、变位机、滚轮架 二手卷板机 数控机床

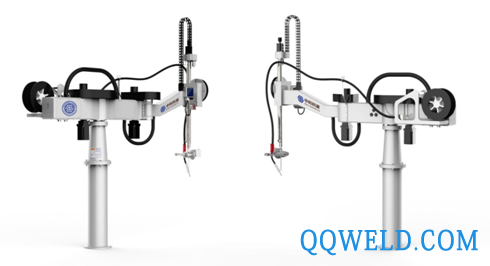

** 80*4米上辊万能卷板机在位出售华鲁产二手卷板机 埋弧焊、变位机、滚轮架 二手卷板机 数控机床 供应精源JYD--03L电感线圈自动焊接机器人 焊接机

供应精源JYD--03L电感线圈自动焊接机器人 焊接机 FANUC、安川焊接机器人工作站(多关节、SCARA机器人)

FANUC、安川焊接机器人工作站(多关节、SCARA机器人)