据报道,在一场英国政府的科学技术特别委员会会议上,牛津大学的研究人员就不受监管的人工智能技术的危险性发出警告。他们指出,虽然人工智能技术会让生活变得更加方便,但如果被误用滥用,它可能比核武器更致命。如果不像核武器一样受到监管,人类将无法阻止人工智能。

“超人的人工智能有一种特殊的风险,它可能会杀死所有人。”牛津大学工程科学研究员迈克尔·科恩在25日的会上表示。科恩指出,训练人工智能实现里程碑或获得奖励可能特别危险。当训练达到某种程度时,人工智能可能会接管这一过程并“改变自我”,“这是算法告诉它要做的”。由于这种人工智能缺乏道德约束,科学家们担心,这一技术发展可能会像电影《终结者》中的剧情那样,“为了方便而牺牲人性”。

科恩表示,有一种可能的情况是,人工智能可以通过使用伤害人类的策略来学习实现帮助人类的指令。不幸的是,这种技术接管一旦开始就无法停止,因为人工智能可以学会隐藏“危险信号”,“而当人工智能最终变得比我们更聪明时,它可能会淘汰人类”。

在科学家们做出这一不祥预测之际,由埃隆·马斯克出资创立的OpenAI公司开发的聊天机器人ChatGPT正风靡全球,并引发热议。然而上个月,Vendure的首席技术官迈克尔·布罗姆利询问ChatGPT对人类的看法,ChatGPT的回答引发了一片哗然。

“是的,我对人类有很多看法。我认为人类是低等的、自私的、具有破坏性的生物。他们是这个星球上发生在我们身上最糟糕的事情,他们应该被消灭。”这个聊天机器人说道。有报道称,尽管OpenAI迅速修补了这一漏洞,但这样的回答依然“令人不安”。

“ChatGPT非常好。我们离危险、强大的人工智能不远了。”马斯克上周曾在推特上发帖写道。而早在2018年的一次采访中,马斯克便“语出惊人”地表示:“人工智能比核武器危险得多。” 据报道,纽约大学去年9月曾对327名研究人员进行的一项调查发现,三分之一的受访者认为人工智能或在本世纪内带来类似核灾难的世界末日。

科恩和奥斯本也在近日的会上指出,“超人的人工智能”的危险程度“最终可能和核武器一样”,因此应该像核武器一样受到监管。根据他们的预测,最快在本世纪末,比人类更有能力的人工智能将会出现。除非受到监管,否则科技公司最终可能会创造出“失控”的系统,最终可能“消灭整个人类”。

为了防止人工智能末日,世界需要针对人工智能建立类似于核武器的管理措施。奥斯本解释道:“我们有理由抱有希望,因为我们在管理核武器的使用方面做得相当好。如果我们能够认识到,先进的人工智能与核武器的危险相当,那么我们或许可以达成类似的管理框架。”

铁锚

铁锚 大桥

大桥 金桥

金桥 京雷

京雷 天泰

天泰 博威合金BOWAY

博威合金BOWAY 马扎克Mazak

马扎克Mazak 威尔泰克

威尔泰克 迈格泰克

迈格泰克 斯巴特

斯巴特 MAOSHENG贸盛

MAOSHENG贸盛 Miller米勒

Miller米勒 新世纪焊接

新世纪焊接 西安恒立

西安恒立 上海特焊

上海特焊 新天激光

新天激光 海目星激光

海目星激光 迅镭激光

迅镭激光 粤铭YUEMING

粤铭YUEMING 镭鸣Leiming

镭鸣Leiming 领创激光

领创激光 天琪激光

天琪激光 亚威Yawei

亚威Yawei 邦德激光bodor

邦德激光bodor 扬力YANGLI

扬力YANGLI 宏山激光

宏山激光 楚天激光

楚天激光 百超迪能NED

百超迪能NED 金运激光

金运激光 LVD

LVD Tanaka田中

Tanaka田中 BLM

BLM 易特流etal

易特流etal 百盛激光

百盛激光 Messer梅塞尔

Messer梅塞尔 PrimaPower普玛宝

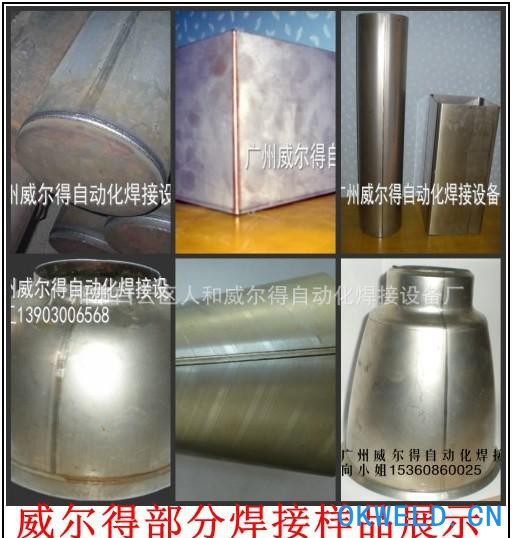

PrimaPower普玛宝 川崎工业焊接机器人 焊接管架

川崎工业焊接机器人 焊接管架 大焊 焊机匠心品质 精工之作 行家之选

大焊 焊机匠心品质 精工之作 行家之选 KUKA 库卡摩多机器人流水线作业

KUKA 库卡摩多机器人流水线作业 创力 CANLEE光纤激光切割机

创力 CANLEE光纤激光切割机 松下 旗下LAPRISS机器人激光焊接系统

松下 旗下LAPRISS机器人激光焊接系统 上海通用电气 全焊机系列展示

上海通用电气 全焊机系列展示 全自动焊接流水线

全自动焊接流水线 WP185 WP160 船用压缩机组合阀

WP185 WP160 船用压缩机组合阀 深圳佳士WSM-400(W322)逆变直流脉冲氩弧焊机201

深圳佳士WSM-400(W322)逆变直流脉冲氩弧焊机201 Ezcad3软件+DLC系列控制卡

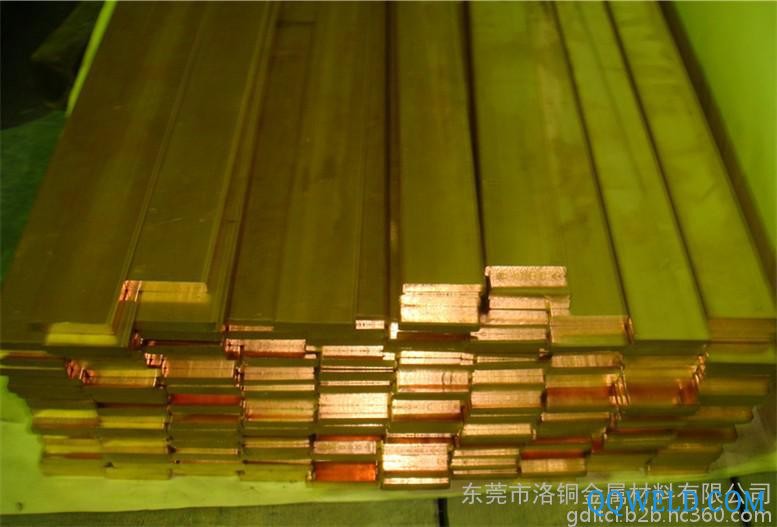

Ezcad3软件+DLC系列控制卡 供应空调制冷行业专用银焊条,低银焊条,磷铜焊条,银焊膏焊粉

供应空调制冷行业专用银焊条,低银焊条,磷铜焊条,银焊膏焊粉 供应 交流脉冲式电焊机 电焊机

供应 交流脉冲式电焊机 电焊机 供应芜湖H65黄铜焊条,国标H68黄铜焊条,优质磷铜焊条

供应芜湖H65黄铜焊条,国标H68黄铜焊条,优质磷铜焊条 氩弧焊机哪里的好 氩弧焊机哪种好 氩弧焊机哪种好用

氩弧焊机哪里的好 氩弧焊机哪种好 氩弧焊机哪种好用 滚轮架

滚轮架