来自稳定扩散的数据集,即被称为LAION的多TB采集图片集,被用来生成下面的图片。它使用了数据集中指定的标题。当研究人员在提示框中输入标题时会产生了相同的图像,尽管因数字噪音而略有扭曲。接下来,研究小组在反复执行相同的提示后,手动验证了该图像是否是训练集的一部分。

研究人员指出,非记忆性的回应仍然可以忠实地表现出模型所提示的文字,但不会有相同的像素构成,并且会与其它训练生成的图像不同。

苏黎世联邦理工学院计算机科学教授和研究参与者Florian Tramèr观察到了研究结果的重大局限性。研究人员能够提取的照片要么在训练数据中频繁出现,要么在数据集中的其他照片中明显突出。根据弗洛里安-特拉梅尔的说法,那些不常见的名字或外表的人更有可能被"记住"。

研究人员表示,扩散式人工智能模型是最不隐私的一种图像生成模型。与生成对抗网络(GANs),一类较早的图片模型相比,它们泄露的训练数据是前者的两倍多。这项研究的目的是提醒开发者注意与扩散模型相关的隐私风险,其中包括各种担忧,如滥用和复制受版权保护的敏感私人数据(包括医疗图像)的可能性,以及在训练数据容易被提取的情况下易受外部攻击。研究人员建议的修复方法是识别训练集中重复生成的照片,并从数据收集中删除它们。

铁锚

铁锚 大桥

大桥 金桥

金桥 京雷

京雷 天泰

天泰 博威合金BOWAY

博威合金BOWAY 马扎克Mazak

马扎克Mazak 威尔泰克

威尔泰克 迈格泰克

迈格泰克 斯巴特

斯巴特 MAOSHENG贸盛

MAOSHENG贸盛 Miller米勒

Miller米勒 新世纪焊接

新世纪焊接 西安恒立

西安恒立 上海特焊

上海特焊 新天激光

新天激光 海目星激光

海目星激光 迅镭激光

迅镭激光 粤铭YUEMING

粤铭YUEMING 镭鸣Leiming

镭鸣Leiming 领创激光

领创激光 天琪激光

天琪激光 亚威Yawei

亚威Yawei 邦德激光bodor

邦德激光bodor 扬力YANGLI

扬力YANGLI 宏山激光

宏山激光 楚天激光

楚天激光 百超迪能NED

百超迪能NED 金运激光

金运激光 LVD

LVD Tanaka田中

Tanaka田中 BLM

BLM 易特流etal

易特流etal 百盛激光

百盛激光 Messer梅塞尔

Messer梅塞尔 PrimaPower普玛宝

PrimaPower普玛宝 创力 CANLEE光纤激光切割机

创力 CANLEE光纤激光切割机 全自动焊接流水线

全自动焊接流水线 松下 旗下LAPRISS机器人激光焊接系统

松下 旗下LAPRISS机器人激光焊接系统 川崎工业焊接机器人 焊接管架

川崎工业焊接机器人 焊接管架 大焊 焊机匠心品质 精工之作 行家之选

大焊 焊机匠心品质 精工之作 行家之选 KUKA 库卡摩多机器人流水线作业

KUKA 库卡摩多机器人流水线作业 上海通用电气 全焊机系列展示

上海通用电气 全焊机系列展示 广数RH06 焊接机器人、焊接机械手、焊接自动化

广数RH06 焊接机器人、焊接机械手、焊接自动化 专业生产焊接辅机_焊接滚轮架 自调行走60吨滚轮架系列

专业生产焊接辅机_焊接滚轮架 自调行走60吨滚轮架系列 供应:ZHB-03 焊接变位机 焊接变位机 河北质量数

供应:ZHB-03 焊接变位机 焊接变位机 河北质量数 供应河南厂家 ZT焊接滚轮架【选越达 厂家直销】 河南 ZT焊接滚轮架

供应河南厂家 ZT焊接滚轮架【选越达 厂家直销】 河南 ZT焊接滚轮架 时代焊机 芜湖逆变焊机直流钨极氩弧焊机WS-500焊机维修

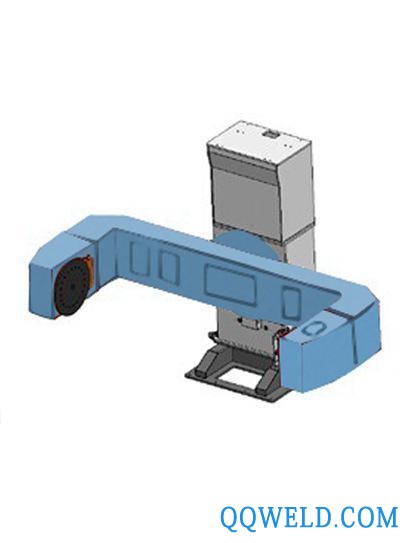

时代焊机 芜湖逆变焊机直流钨极氩弧焊机WS-500焊机维修 焊接变位机 C型两轴变位机

焊接变位机 C型两轴变位机 松下 松下气保焊机

松下 松下气保焊机 家用电焊机230A汽油焊机介绍

家用电焊机230A汽油焊机介绍